采集网站内容(如何使用Scrapy结合PhantomJS框架写一个_MIDDLEWARES资料总结)

优采云 发布时间: 2021-10-01 23:13采集网站内容(如何使用Scrapy结合PhantomJS框架写一个_MIDDLEWARES资料总结)

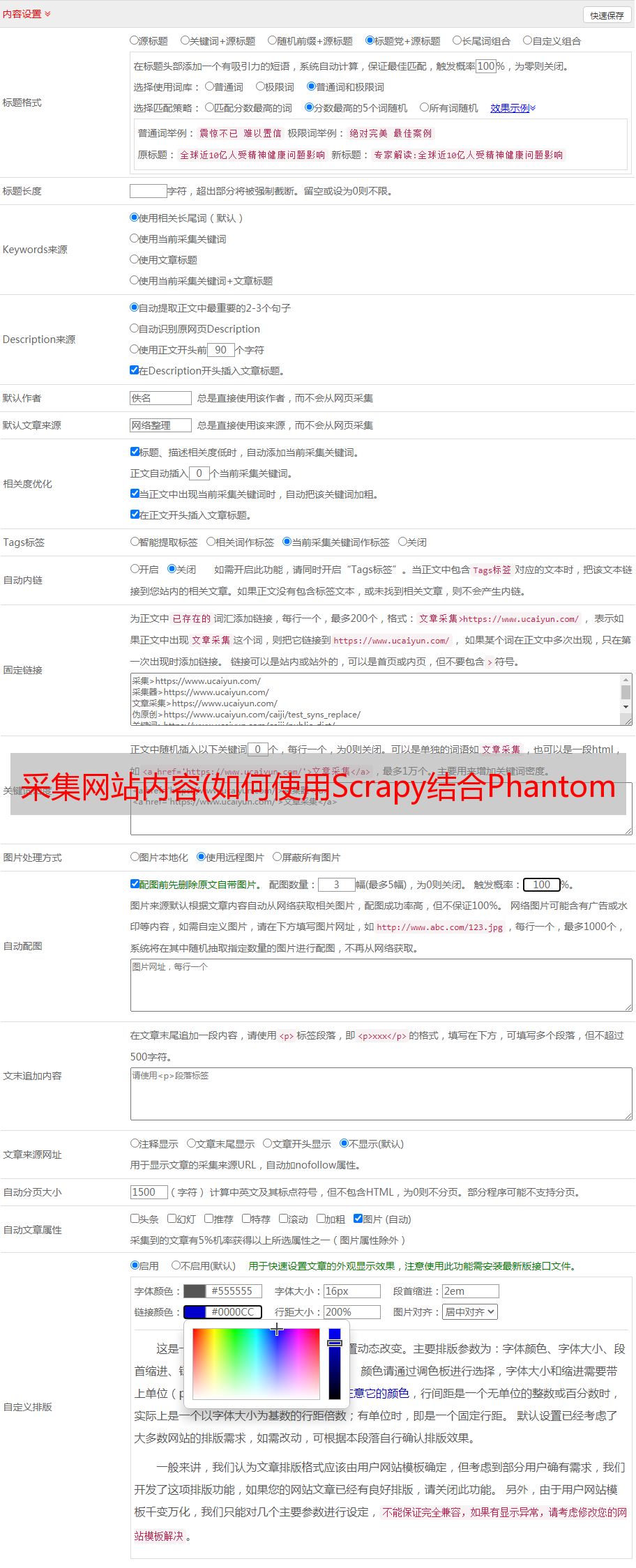

一,。导言

最近,我一直在研究scrapy crawler框架,并尝试使用scrapy框架编写一个可以实现web信息的简单小程序采集。我在尝试的过程中遇到了很多小问题。我希望你能给我更多的建议

本文主要介绍如何结合phantom JS采集天猫商品内容使用scripy。本文定制了一个下载程序u中间件用于采集需要加载JS的动态网页内容。阅读了很多关于downloader的内容。总之,midviews数据使用起来很简单,但是它会阻塞框架,因此性能很差。在一些materials_uhandler中提到了自定义下载程序,或者使用grapyjs可以解决阻塞框架的问题。感兴趣的合作伙伴可以研究它。我不会在这里谈论它

二,。具体实施

2.1,环境要求

您需要执行以下步骤来准备python开发和运行环境:

以上步骤显示了两种安装方式:1。安装并下载本地车轮套件;2.使用Python安装管理器执行远程下载和安装。注意:包版本需要与python版本匹配

2.2,开发和测试过程

首先,找到需要采集的页面。这是天猫的产品。该网站为/item/526449276263.HTM。网页如下:

然后开始编写代码。默认情况下,以下代码在命令行界面中执行

1),创建scratch crawler项目tmspider

E:\python-3.5.1>scrapy startproject tmSpider

2),修改settings.py配置

配置如下:

DOWNLOADER_MIDDLEWARES = {

'tmSpider.middlewares.middleware.CustomMiddlewares': 543,

'scrapy.contrib.downloadermiddleware.useragent.UserAgentMiddleware': None

}

3),在项目目录下创建middleware文件夹,然后在该文件夹下创建middleware.py文件。代码如下:

# -*- coding: utf-8 -*-

from scrapy.exceptions import IgnoreRequest

from scrapy.http import HtmlResponse, Response

import tmSpider.middlewares.downloader as downloader

class CustomMiddlewares(object):

def process_request(self, request, spider):

url = str(request.url)

dl = downloader.CustomDownloader()

content = dl.VisitPersonPage(url)

return HtmlResponse(url, status = 200, body = content)

def process_response(self, request, response, spider):

if len(response.body) == 100:

return IgnoreRequest("body length == 100")

else:

return response

4),使用selenium和phantom JS编写web内容下载程序,并在上一步创建的Middleware文件夹中创建downloader.py文件。代码如下:

# -*- coding: utf-8 -*-

import time

from scrapy.exceptions import IgnoreRequest

from scrapy.http import HtmlResponse, Response

from selenium import webdriver

import selenium.webdriver.support.ui as ui

class CustomDownloader(object):

def __init__(self):

# use any browser you wish

cap = webdriver.DesiredCapabilities.PHANTOMJS

cap["phantomjs.page.settings.resourceTimeout"] = 1000

cap["phantomjs.page.settings.loadImages"] = True

cap["phantomjs.page.settings.disk-cache"] = True

cap["phantomjs.page.customHeaders.Cookie"] = 'SINAGLOBAL=3955422793326.2764.1451802953297; '

self.driver = webdriver.PhantomJS(executable_path='F:/phantomjs/bin/phantomjs.exe', desired_capabilities=cap)

wait = ui.WebDriverWait(self.driver,10)

def VisitPersonPage(self, url):

print('正在加载网站.....')

self.driver.get(url)

time.sleep(1)

# 翻到底,详情加载

js="var q=document.documentElement.scrollTop=10000"

self.driver.execute_script(js)

time.sleep(5)

content = self.driver.page_source.encode('gbk', 'ignore')

print('网页加载完毕.....')

return content

def __del__(self):

self.driver.quit()

5)创建爬虫模块

在项目目录e:\Python-3.5.1\tmspider中,执行以下代码:

E:\python-3.5.1\tmSpider>scrapy genspider tmall 'tmall.com'

执行后,将在项目目录e:\Python-3.5.1\tmspider\tmspider\spider中自动生成tmall.py程序文件。程序中的parse函数处理脚本下载程序返回的网页内容。采集网页信息的方法可以是:

# -*- coding: utf-8 -*-

import time

import scrapy

import tmSpider.gooseeker.gsextractor as gsextractor

class TmallSpider(scrapy.Spider):

name = "tmall"

allowed_domains = ["tmall.com"]

start_urls = (

'https://world.tmall.com/item/526449276263.htm',

)

# 获得当前时间戳

def getTime(self):

current_time = str(time.time())

m = current_time.find('.')

current_time = current_time[0:m]

return current_time

def parse(self, response):

html = response.body

print("----------------------------------------------------------------------------")

extra=gsextractor.GsExtractor()

extra.setXsltFromAPI("31d24931e043e2d5364d03b8ff9cc77e", "淘宝天猫_商品详情30474","tmall","list")

result = extra.extract(html)

print(str(result).encode('gbk', 'ignore').decode('gbk'))

#file_name = 'F:/temp/淘宝天猫_商品详情30474_' + self.getTime() + '.xml'

#open(file_name,"wb").write(result)

6),启动爬虫程序

在E:\Python-3.5.1\tmspider项目目录中执行该命令

E:\python-3.5.1\simpleSpider>scrapy crawl tmall

输出结果:

请注意,上述命令一次只能启动一个爬虫程序。如果要同时启动多个爬虫程序,该怎么办?然后您需要定制一个爬虫程序启动模块。在spider下创建模块文件runcrawl.py。代码如下

# -*- coding: utf-8 -*-

import scrapy

from twisted.internet import reactor

from scrapy.crawler import CrawlerRunner

from tmall import TmallSpider

...

spider = TmallSpider(domain='tmall.com')

runner = CrawlerRunner()

runner.crawl(spider)

...

d = runner.join()

d.addBoth(lambda _: reactor.stop())

reactor.run()

执行runcrawl.py文件并输出结果:

三,。前景

为了定制Downloader,在通过调用phantomjs实现爬虫程序之后,Middleware长期以来一直在努力解决阻塞框架的问题,并试图找到解决方案。稍后,我们将研究其他调用浏览器的方法,例如grapyjs和splash,看看它们是否可以有效地解决这个问题

四,。有关文件

一,。Python即时web爬虫:API描述

五,。Jisoke gooseeker开源代码下载源代码

一,。Gooseeker开源Python网络爬虫GitHub源代码

六,。文档修改历史记录

12016-06-30:V1.0