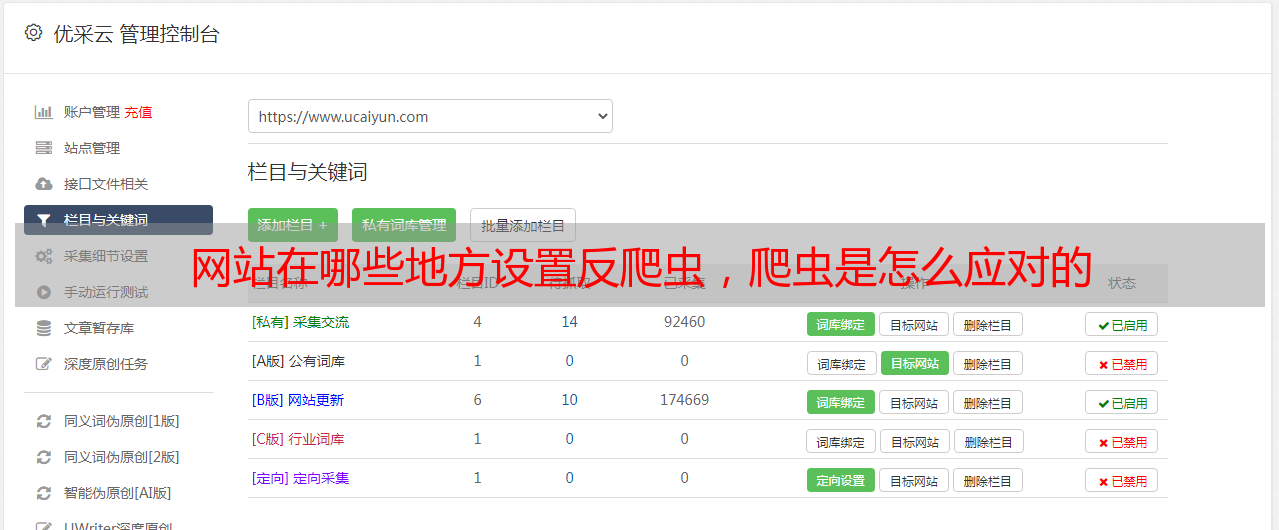

网站在哪些地方设置反爬虫,爬虫是怎么应对的

优采云 发布时间: 2021-07-04 20:20网站在哪些地方设置反爬虫,爬虫是怎么应对的

自从互联网诞生以来,就有爬虫和反爬虫。 网站越大,网站越成熟,反爬虫机制越完善,初始IP限制,验证码限制等今天小编就来告诉你网站在哪里设置反爬虫,以及爬行动物如何反应。

1、用户行为反爬虫

网站的一部分检测用户行为,例如同一IP在短时间内多次访问同一页面,或同一账号在短时间内多次执行相同操作。

大多数网站 都是前一种情况。在这种情况下,使用IP代理可以解决。我们可以在检测后将代理IP保存在一个文件中,但这种方法不可取。代理IP失败的可能性非常高。因此,实时抓取代理IP网站是一个不错的选择。

对于第二种情况,您可以在每次请求后以几秒的随机间隔发出下一个请求。一些存在逻辑漏洞的网站可以通过多次请求、注销、重新登录、继续请求来绕过同一账号短时间内不能多次创建的限制。

对于cookies,需要登录的网站,经常使用这种技术,通过检查cookies来判断用户是否是合法用户。更深入一些,一些网站登录会动态更新认证。登录时,将随机分配用于登录认证的authentication_token,将authentication_token与用户提交的登录名和密码一起发送回服务器。

2、Anti-crawler 通过 Headers

用户请求的Headers反爬虫是最常见的反爬虫策略。很多网站会检测Headers的User-Agent,有的网站会检测Referer(部分资源网站的反盗取就是检测Referer)。

如果遇到这种反爬虫机制,可以直接给爬虫添加Headers,将浏览器的User-Agent复制到爬虫的Headers中;或者修改Referer值为目标网站域名。对于检测header的反爬虫,在爬虫中修改或添加header很容易绕过。

3、限制对某些 IP 的访问

可以从很多网站处获得免费代理IP。由于爬虫可以使用这些代理IP进行网站的爬取,网站也可以使用这些代理IP进行反向限制并将这些IP保存在服务器来限制使用代理IP进行爬取的爬虫。

4、动态页面反爬虫

有时候抓取目标页面,发现关键信息内容是空白的,只有框架代码。这是因为网站信息是通过用户Post的XHR动态返回的内容信息解决这个问题的方法是通过开发者工具(FireBug等)分析网站stream,找到单独的内容信息请求(如Json),抓取内容信息,获取需要的内容。

稍微复杂一点的是动态请求的加密,无法解析参数,所以无法爬取。在这种情况下,可以使用Mechanize、selenium RC来调用浏览器内核,就像真正使用浏览器上网一样,可以最大限度地提高爬取成功率,但会影响效率。

来自“ITPUB博客”,链接:,如需转载请注明出处,否则将追究法律责任。