如何利用Scrapy爬虫框架抓取网页全部文章信息(上篇)

优采云 发布时间: 2022-05-05 17:11如何利用Scrapy爬虫框架抓取网页全部文章信息(上篇)

点击上方“Python爬虫与数据挖掘”,进行关注

回复“书籍”即可获赠Python从入门到进阶共10本电子书

今

日

鸡

汤

孤灯不明思欲绝,卷帷望月空长叹。

/前言/

前一段时间小编给大家分享了Xpath和CSS选择器的具体用法,感兴趣的小伙伴可以戳这几篇文章温习一下,,,、、、,学会选择器的具体使用方法,可以帮助自己更好的利用Scrapy爬虫框架。在接下来的几篇文章中,小编将给大家讲解爬虫主体文件的具体代码实现过程,最终实现网页所有内容的抓取。

前一阶段我们已经实现了通过Scrapy抓取某一具体网页页面的具体信息,、,但是未实现对所有页面的依次提取。首先我们理一下爬取思路,大致思想是:当获取到第一个页面的URL之后,尔后将第二页的URL发送给Scrapy,让Scrapy去自动下载该网页的信息,之后通过第二页的URL继续获取第三页的URL,由于每一页的网页结构是一致的,所以通过这种方式如此反复进行迭代,便可以实现整个网页中的信息提取。其具体的实现过程将通过Scrapy框架来进行实现,具体的教程如下。

/具体实现/

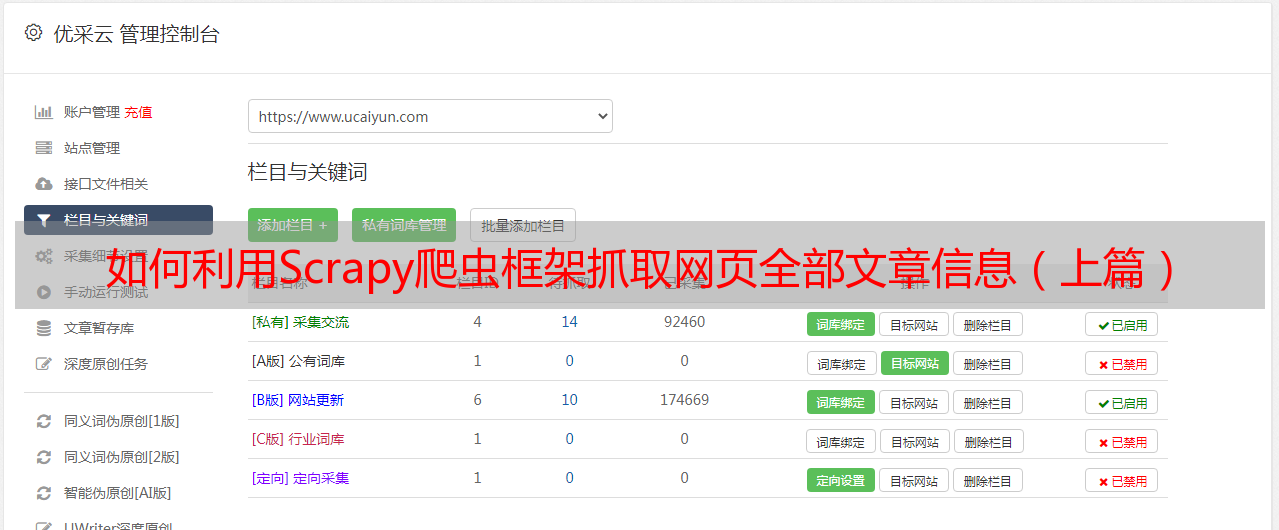

1、首先URL不再是某一篇具体文章的URL了,而是所有文章列表的URL,如下图所示,将链接放到start_urls里边,如下图所示。

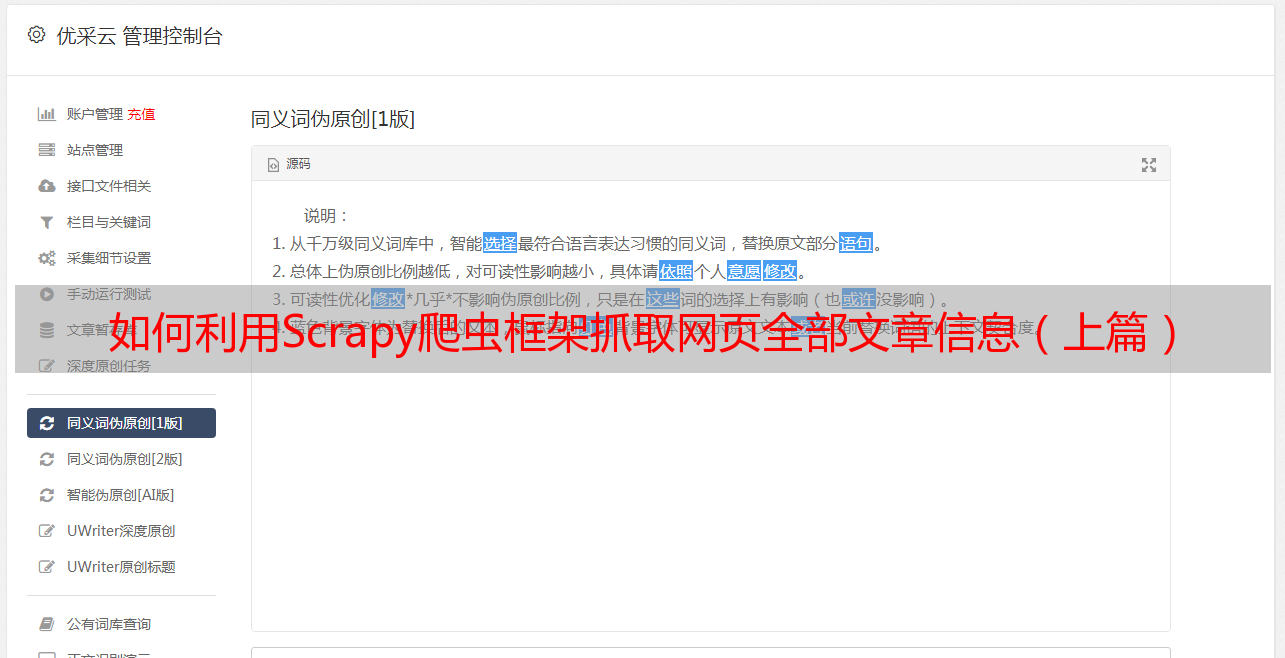

2、接下来我们将需要更改parse()函数,在这个函数中我们需要实现两件事情。

其一是获取某一页面所有文章的URL并对其进行解析,获取每一篇文章里的具体网页内容,其二是获取下一个网页的URL并交给Scrapy进行下载,下载完成之后再交给parse()函数。

有了之前的Xpath和CSS选择器基础知识之后,获取网页链接URL就变得相对简单了。

3、分析网页结构,使用网页交互工具,我们可以很快的发现每一个网页有20篇文章,即20个URL,而且文章列表都存在于id="archive"这个标签下面,之后像剥洋葱一样去获取我们想要的URL链接。

4、点开下拉三角,不难发现文章详情页的链接藏的不深,如下图圈圈中所示。

5、根据标签我们按图索骥,加上选择器利器,获取URL犹如探囊取物。在cmd中输入下图命令,以进入shell调试窗口,事半功倍。再次强调,这个URL是所有文章的网址,而不是某一篇文章的URL,不然后面你调试半天都不会有结果的。

6、根据第四步的网页结构分析,我们在shell中写入CSS表达式,并进行输出,如下图所示。其中a::attr(href)的用法很巧妙,也是个提取标签信息的小技巧,建议小伙伴们在提取网页信息的时候可以经常使用,十分方便。

至此,第一页的所有文章列表的URL已经获取到了。提取到URL之后,如何将其交给Scrapy去进行下载呢?下载完成之后又如何调用我们自己定义的解析函数呢?