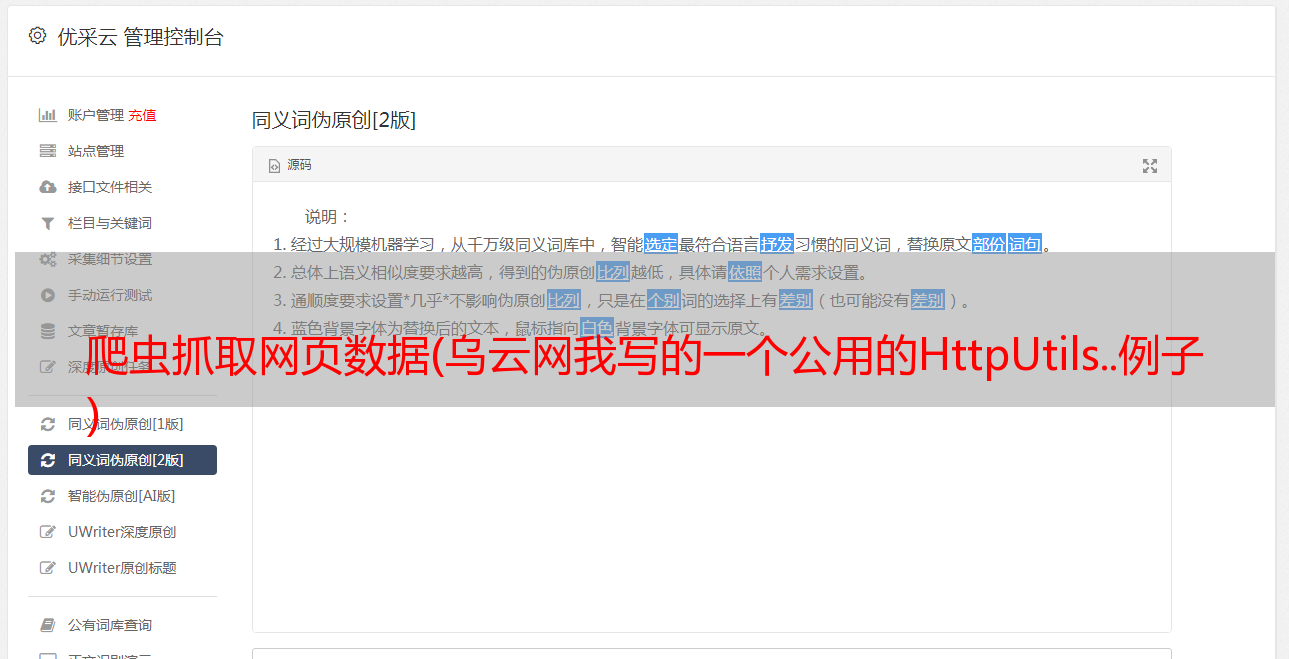

爬虫抓取网页数据(乌云网我写的一个公用的HttpUtils..例子 )

优采云 发布时间: 2022-02-10 12:09爬虫抓取网页数据(乌云网我写的一个公用的HttpUtils..例子

)

最近,我在公司做了一个系统。由于想获取网页的一些数据和一些网页的数据,所以写了一个公共的HttpUtils。以下是我为无云网写的一个例子。

一、第一步,获取指定路径下的网页内容。

public static String httpGet(String urlStr, Map params) throws Exception {

StringBuilder sb = new StringBuilder();

if (null != params && params.size() > 0) {

sb.append("?");

Entry en;

for (Iterator ir = params.entrySet().iterator(); ir.hasNext();) {

en = ir.next();

sb.append(en.getKey() + "=" + URLEncoder.encode(en.getValue(),"utf-8") + (ir.hasNext() ? "&" : ""));

}

}

URL url = new URL(urlStr + sb);

HttpURLConnection conn = (HttpURLConnection) url.openConnection();

conn.setConnectTimeout(5000);

conn.setReadTimeout(5000);

conn.setRequestMethod("GET");

if (conn.getResponseCode() != 200)

throw new Exception("请求异常状态值:" + conn.getResponseCode());

BufferedInputStream bis = new BufferedInputStream(conn.getInputStream());

Reader reader = new InputStreamReader(bis,"gbk");

char[] buffer = new char[2048];

int len = 0;

CharArrayWriter caw = new CharArrayWriter();

while ((len = reader.read(buffer)) > -1)

caw.write(buffer, 0, len);

reader.close();

bis.close();

conn.disconnect();

//System.out.println(caw);

return caw.toString();

}

浏览器查询结果:

代码查询结果同上:

二、通过指定url获取网页上你想要的数据。

对于这个方法,导入Jsoup包,可以从网上下载。

Document doc = null;

try {

doc = Jsoup.connect("http://www.wooyun.org//bugs//wooyun-2016-0225856").userAgent("Mozilla/5.0 (Windows NT 10.0; Trident/7.0; rv:11.0) like Gecko").timeout(30000).get();

} catch (IOException e) {

e.printStackTrace();

}

for(Iterator ir = doc.select("h3").iterator();ir.hasNext();){

System.out.println(ir.next().text());

}

对于那个select选择器,根据条件选择,doc.select("h3").iterator(),对于Jsoup有如下规则:

jsoup 是一个基于 Java 的 HTML 解析器,可以直接解析 URL 地址或 HTML 文本内容。它提供了一个非常省力的 API,用于通过 DOM、CSS 和类似 jQuery 的操作方法获取和操作数据。

jsoup 的强大之处在于它可以检索文档元素。 Select 方法将返回元素集合并提供一组方法来提取和处理结果。要掌握Jsoup,首先要熟悉它的选择器语法。

1、选择器选择器基本语法

2、选择器选择器组合语法

3、选择器伪选择器语法

注意:上述伪选择器的索引是从0开始的,也就是说第一个元素的索引值为0,第二个元素的索引值为1,以此类推

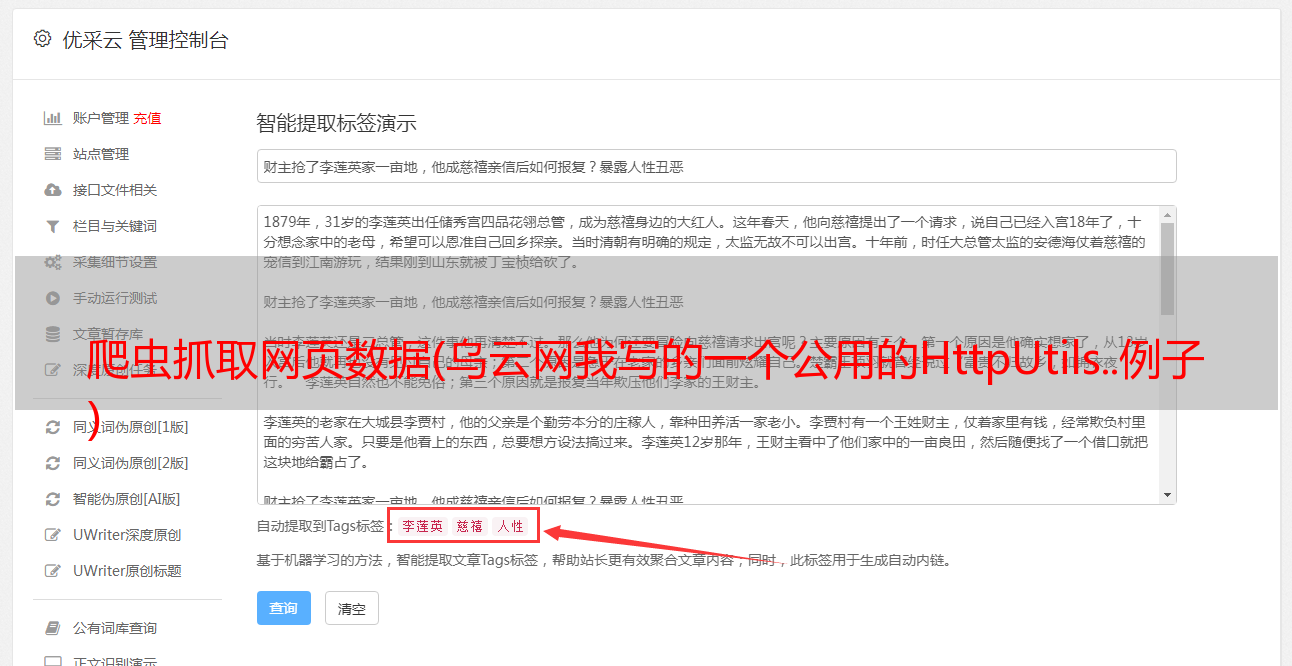

浏览器访问:

代码访问: